Distributed Learning

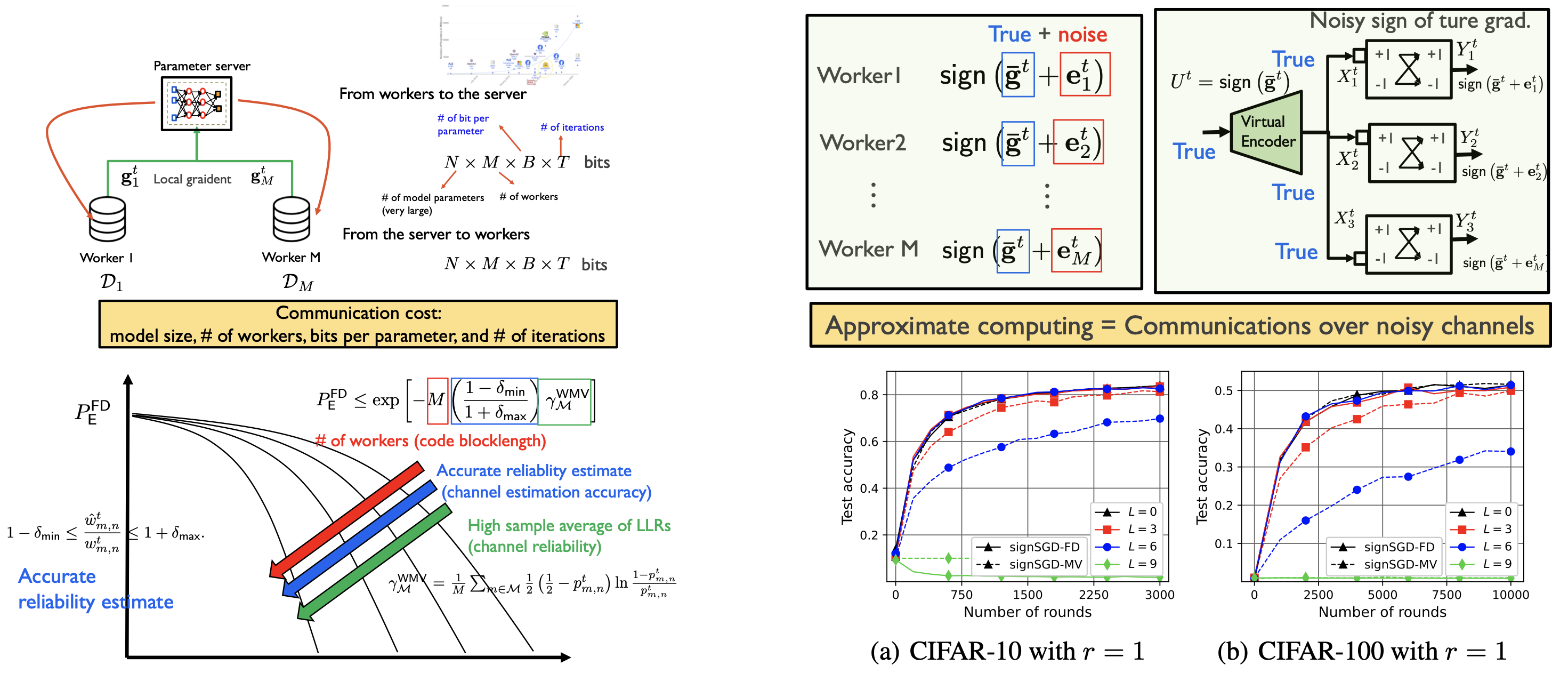

분산학습(Distributed Learning)의 통신 비용 절감을 위한 방법론을 제시한다. 핵심 아이디어는 signSGD 알고리즘을 코딩 이론(Coding Theory)의 프레임워크 내에서 분석하고, 이를 통신 이론(Communication Theory)을 통해 재해석하여 통신 효율성을 최적화하는 것이다. 이를 통해 개발된 해석 가능한 signSGD 알고리즘은 단순히 통신량을 줄이는 것을 넘어 다양하 데이터 환경, 외부 공격, 시스템 이질성 등 분산 학습이 직면하는 복잡한 도전 과제에 대응할 수 있는 견고한 이론적 기반을 제공한다.